Hace 70 años, el matemático Alan Turing, en su artículo “Computing machinery and Intelligence, Mind”, se preguntaba si las máquinas podrían pensar, cuestión que en su momento marcó el inicio de la inteligencia artificial y que hoy sigue provocando el trabajo de científicos que buscan acercarse a lo que había visualizado el británico a mitad del siglo pasado.

José Alberto Pineda Cortés, del Instituto de Investigaciones en Matemáticas Aplicadas y en Sistema (IIMAS), explicó que el mismo Turing señalaba que se trataba de enseñar el lenguaje a las máquinas para que pudieran aprender a través de él, para que pudiéramos esperar que las máquinas llegaran a competir con los seres humanos en todos los campos puramente intelectuales”.

En ese sentido, los caminos podrían ser de dos tipos y el mismo matemático daría luz para ello: darle a la máquina el conocimiento o crear la máquina de aprendizaje, esta último se conoce como la máquina niño, que debe tener el estado inicial de la mente (al nacer), un diseño de mecanismos de aprendizaje simples, pero de carácter general. Mucha educación (como a los niños) y mucha experimentación.

En la videoconferencia “Aprendizaje de máquina e inteligencia artificial” se refirió al trabajo transdisciplinario con otras áreas del conocimiento que ha logrado la construcción de máquinas con inteligencia artificial, un ejemplo de ello es Golem, un robot de servicio que han desarrollado científicos de la Universidad.

Hasta hoy, expuso, el desarrollo más importante que ha tenido el robot es su arquitectura cognitiva, orientada a la interacción y un lenguaje de programación, que se llama SitLog (situaciones y lógica), para realizar diagnósticos, tomar decisiones dinámicamente y diseñar planes para que las decisiones tomen efecto, se trata de un desarrollo continuo de muchos años.

Golem tiene programado un esquema genérico de la conducta que un mayordomo puede tener, aunque se desempeña de manera adecuada en este contexto, “estamos aún distantes de tener un robot que asemeje a la conducta humana”, afirmó.

En cambio, explicó, se puede pensar en escenarios prácticos, se toma una tarea humana y se simplifica en una variedad de dimensiones, con lo que se crea un esquema de la conducta práctica, distante de la complejidad de la actividad humana. Se hace una tarea práctica de juguete, es decir, un escenario más sencillo. Los robots más avanzados se desempeñan en tareas prácticas de juguetes, que son altamente determinadas.

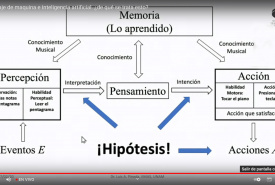

La memoria humana, comentó, es un objeto complejo y asociativo, además de que permite guardar una cantidad grandísima de información (que es la experiencia de vida) y las computadoras tienen memorias por localidades, aunque las actuales parecen ser muy impresionantes por su capacidad de guardar datos, aún no se llega a esos niveles.

Al respecto, dijo, se tiene que dotar a los robots de memorias asociativas, pero eso es “un tema de investigación muy grande, también hay que tomar en cuenta la racionalidad, ya que la conducta humana tiene un altísimo grado de indeterminación, por eso podemos tomar decisiones libremente porque nuestra mente no está determinada ni el mundo tampoco, por lo que todavía falta mucho”.

La prueba ácida de la máquina niño, de Turing, que ninguna máquina del mundo ha alcanzado, es enseñarle a una computadora el lenguaje natural para que después ésta pueda aprender a través de él, por lo que estamos muy distantes de crear a la máquina niño, aseveró.

No obstante, indicó, el gran éxito de la inteligencia artificial, sobre todo con las redes neuronales profundas, son las máquinas de aprendizaje de habilidades motoras y perceptuales bastante generales, de ahí que se hayan podido construir vehículos autónomos, que son motores perceptuales, pero no tienen la parte del pensamiento y comunicación lingüística porque es más compleja.

Finalmente, se refirió a la alta responsabilidad de quien desarrolla tecnología, “las computadoras no toman decisiones, quien tiene la tecnología tiene la responsabilidad de cómo la utiliza, el problema ético está en los seres humanos”.